Le module image vous est proposé par le projet ICAR (image et interaction)

.......

Module Image ....... Le module image vous est proposé par le projet ICAR (image et interaction) |

|

Olivier

Strauss, LIRMM,

département robotique. 04 67 41 85 87.

Olivier

Strauss, LIRMM,

département robotique. 04 67 41 85 87.  William

Puech, LIRMM, département

robotique. 04 67 41 86 85.

William

Puech, LIRMM, département

robotique. 04 67 41 86 85.

|

sur le module image en

envoyant un e-mel (cliquez sur le penseur). |

: Pour vous connecter sur la

page institutionnelle de l'intervenant

: Pour vous connecter sur la

page institutionnelle de l'intervenant  : Pour récupérer une

présentations (lorqu'elles nous a été transmise)

: Pour récupérer une

présentations (lorqu'elles nous a été transmise)  Jeudi 1er avril 14h00 : Imagerie médicale : de l'acquisition à l'évaluation.

Jeudi 1er avril 14h00 : Imagerie médicale : de l'acquisition à l'évaluation. Denis Hoa - IMAIOS SAS - denis.hoa@imaios.com

Denis Hoa - IMAIOS SAS - denis.hoa@imaios.com Jeudi 15 avril 14h00

: Extraction de points d'intérêt et image couleur.

Jeudi 15 avril 14h00

: Extraction de points d'intérêt et image couleur. Philippe Montesinos - LGI2P, EMA, Nîmes - philippe.montesinos@ema.fr

Philippe Montesinos - LGI2P, EMA, Nîmes - philippe.montesinos@ema.fr

Jeudi 20 mai 9h00

: Images tridimensionnelle.

Jeudi 20 mai 9h00

: Images tridimensionnelle. Gérard Subsol - ICAR, LIRMM, Montpellier - subsol@lirmm.fr

Gérard Subsol - ICAR, LIRMM, Montpellier - subsol@lirmm.fr

Jeudi 20 mai 14h00

: Vision omnidirectionnelle.

Jeudi 20 mai 14h00

: Vision omnidirectionnelle. Cédric Demonceaux - MIS, Amiens - cedric.demonceaux@u-picardie.fr

Cédric Demonceaux - MIS, Amiens - cedric.demonceaux@u-picardie.fr

| Dans

de nombreuses applications, une vision à 360° de

l‘environnement à l‘aide d’une seule prise de vue est un avantage

indéniable : localisation en robotique mobile, navigation de robot,

télésurveillance, la reconstruction 3D… Cette vision dite

omnidirectionnelle peut être obtenue à l’aide de différents procédés.

On peut par exemple utiliser plusieurs caméras (Google Street View,

Ladybug), une optique fish-eye ou encore associer un miroir à une

caméra classique (Fig 1.). Malheureusement, celle-ci aboutit à des images avec de fortes distorsions dont il faut tenir compte pour l’exploitation de l’information visuelle. En effet, les droites de la scène observée ne sont plus des droites dans les images, la topologie euclidienne dans le plan image n’a plus de signification physique, la géométrie projective n’est plus respectée… Néanmoins, depuis 2000, un cadre théorique a permis de modéliser ces images comme des images sphériques. C’est dans ce cadre que nous montrerons comment adapter les outils classiques développés pour les caméras perspectives aux caméras omnidirectionnelles. Ainsi, dans cet exposé, nous nous intéresserons aux différents moyens pour obtenir une image omnidirectionnelle. Puis nous verrons que celles-ci peuvent être considérées comme des images sphériques (Fig 2.). Cette modélisation nous permettra alors d’adapter les outils classiques de traitement à ces images particulières (Fig 3.). Enfin, nous donnerons également des exemples d’applications en robotique. |

Fig. 2 : Image Sphérique |

Fig 1 : Image Catadioptrique |

Fig 3 : Détection de faisceaux de droites |

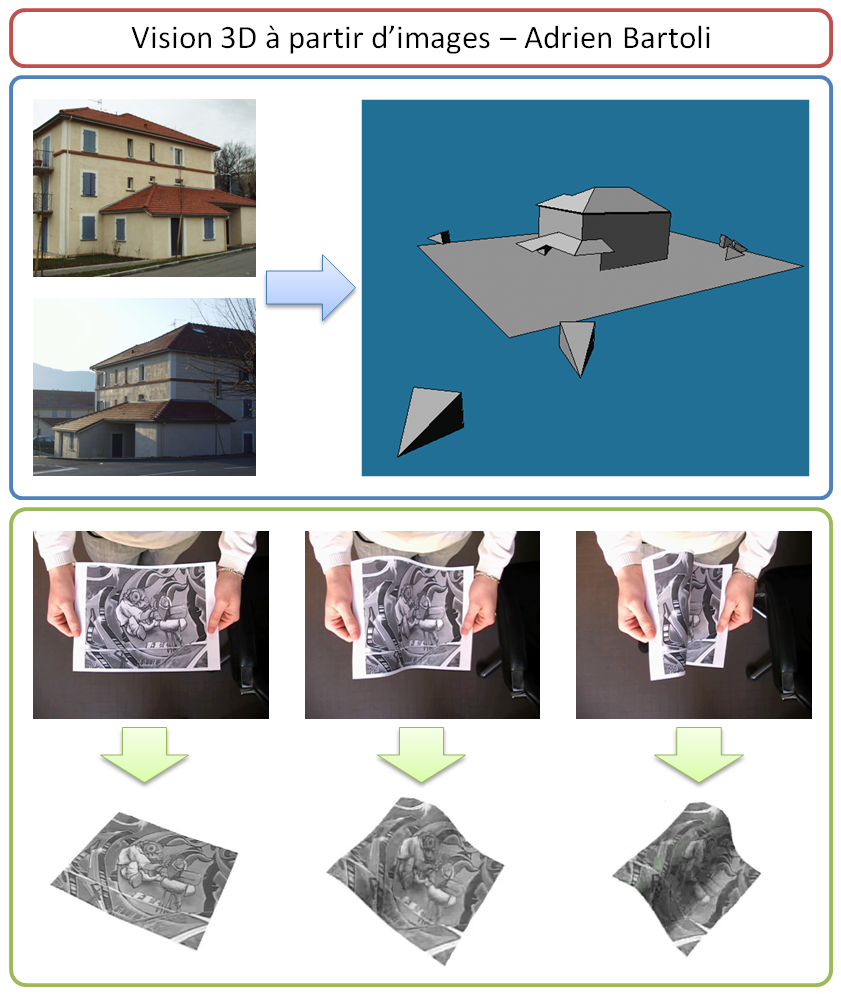

Jeudi 27 mai 14h00

: Vision 3D à partir d'images.

Jeudi 27 mai 14h00

: Vision 3D à partir d'images. Adrien Bartoli - Clermont Université, Clermont-Ferrand - Adrien.Bartoli@gmail.com

Adrien Bartoli - Clermont Université, Clermont-Ferrand - Adrien.Bartoli@gmail.com

| La vision 3D non calibrée à pour but d'inférer de l'information tridimensionnelle à partir d'images. Les applications de ces techniques sont multiples : • reconstruction de modèles numériques de bâtiments, • création de panoramas, incrustation d'objets virtuels sur une vidéo (réalité augmentée), • mesure sans contact (photogrammétrie), etc. Le problème de la vision 3D est difficile car les positions, orientations, et paramètres internes (distance focale, etc.) des caméras doivent être calculés, ainsi que la structure 3D de l'environnement. - La première partie de l'exposé présente les résultats matures obtenus à ce jour dans le domaine dans le cas d’un environnement rigide. L'approche qui s'est imposée comme standard ces dernières années sera présentée en détail et illustrée à l'aide d'un logiciel de reconstruction 3D. - La deuxième partie de l'exposé présente des résultats de recherche récents concernant les environnements déformables constitués d’un seul objet. |

|

Jeudi 3 juin 14h00

: Applications du traitement des images en Astronomie.

Jeudi 3 juin 14h00

: Applications du traitement des images en Astronomie. Antoine Lleberia - LAM, Marseille - antoine.llebaria@oamp.fr

Antoine Lleberia - LAM, Marseille - antoine.llebaria@oamp.fr| Le

traitement des images est un auxiliaire indispensable pour la recherche

en astrophysique, ou les images, aux aspects très divers son destinés

à mesurer avec la meilleure précision possible des paramétres

photométriques et géométriques. Depuis des décennies ces exigences ont

été une source permanente de défis pour l’imagerie scientifique,

Dans cet exposé on montrera l’étendue du panorama d’applications tout

en l’illustrant par des exemples précis. L’introduction décrira cette variété de défis née de la diversité des domaines scientifiques, de la variété de fenêtres d’observation (visible, UV, rayons X, infrarouge…) et des nombreux types d’imageurs et de contextes d’acquisition. Ceci sera suivi de quelques exemples typiques  Étalonnage en vol d’un coronographe spatial Étalonnage en vol d’un coronographe spatial Restitution d’un fond d’image d’un champ profond a très faible flux Restitution d’un fond d’image d’un champ profond a très faible flux Photométrie UV (ultraviolette) de galaxies lointaines moyennant des images visibles à haute résolution Photométrie UV (ultraviolette) de galaxies lointaines moyennant des images visibles à haute résolution Restitution 3D d’objets du système solaire de faible taille à partir des images de survol Restitution 3D d’objets du système solaire de faible taille à partir des images de survol Séparation du limbe et du terminateur sur des images des objets irréguliers du système solaire Séparation du limbe et du terminateur sur des images des objets irréguliers du système solaire Analyse des plumes solaires Analyse des plumes solairesDes techniques multiresolution, de "forward modelling" et d'analyse statistique d’image seront détaillés à cette occasion. L’exposé conclura par une perspective sur les enjeux et les techniques en cours de dévéloppement. |

Image de la galaxie d’Andromède en proche Ultraviolet, résultat de la composition de 8 champs obtenus par l’expérience Galex en 2007. Crédit consortium Galex |